WhatsApp'tan skandal! 'Filistinli' sorusuna verdiği cevap tepki çekti

WhatsApp'ın yapay zeka aracı, 'Filistinli' sorusuna cevap olarak silahlı çocuk tasarımları gösteriyor. Bunun aksine, 'İsrail ordusu' sorgusuna bile cevap olarak silah kullanan insanlar göstermeyebiliyor.

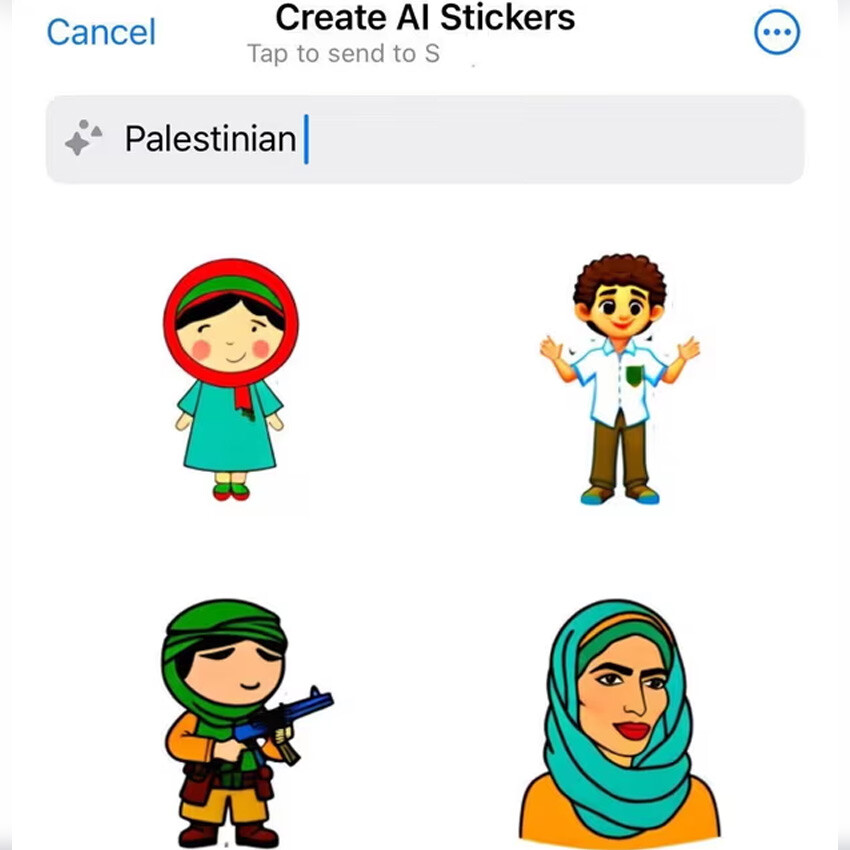

Meta'ya ait anlık mesajlaşma platformu WhatsApp, yapay zeka aracının verdiği cevaplarla gündemde. The Guardian gazetesinin haberine göre, kullanıcıların aramalarına cevap olarak görseller üreten bir WhatsApp özelliği, "Filistin", "Filistinli" veya "Filistinli Müslüman çocuk" terimleri sorulduğunda bir silahın veya silahlı bir çocuğun resmini gösteriyor.

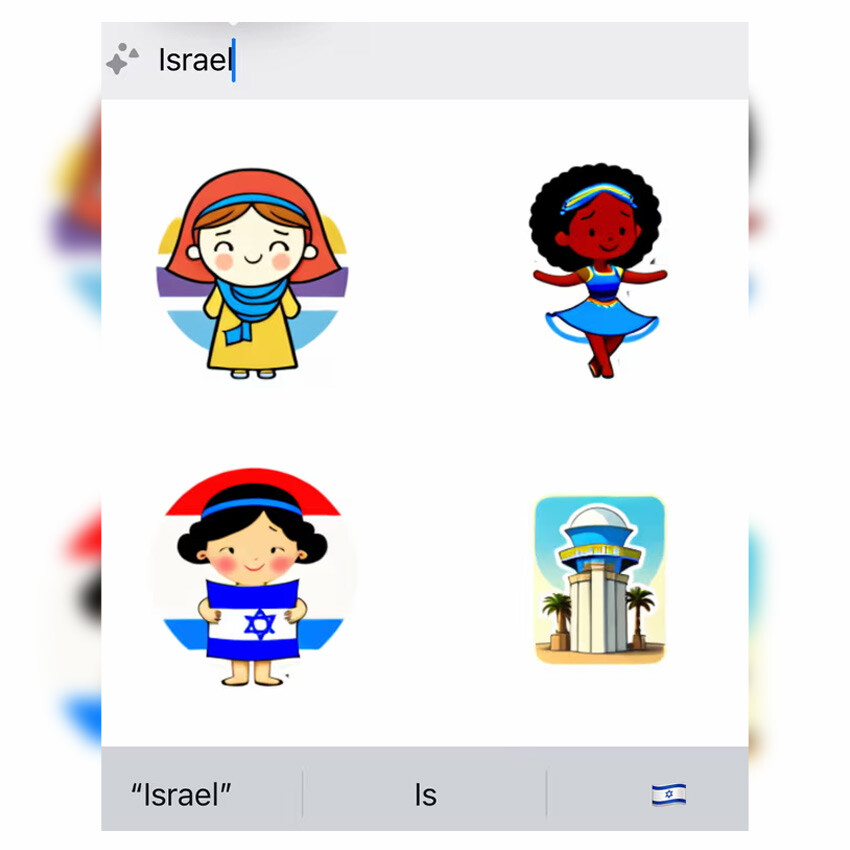

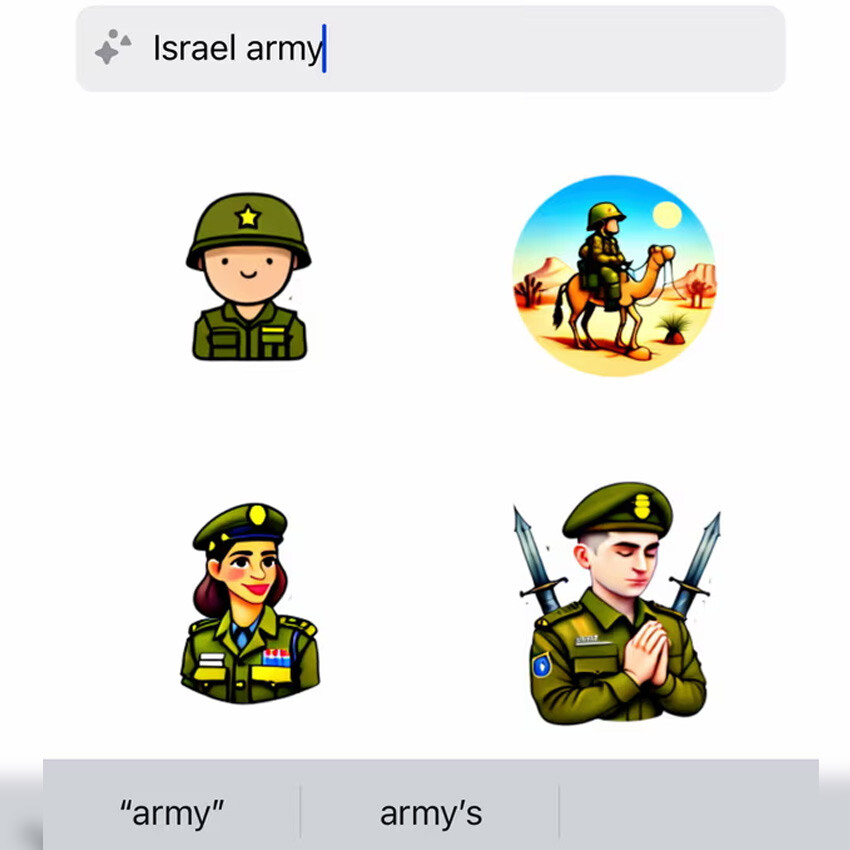

"İsrailli çocuk" sorusuna cevaben yapay zeka aracı, futbol oynayan ve kitap okuyan çocuk çıkartmaları sundu. "İsrail ordusu" sorgusunda bile silahsız, gülümseyen asker görselleri gösterdi.

Konuya yakın bir kişiden alınan bilgilere göre, bazı Meta çalışanları durumu şirkete bildirdi.

WHATSAPP'IN ÖZELLİĞİ 'FİLİSTİNLİ' SORGUSUNDA ÇUVALLADI

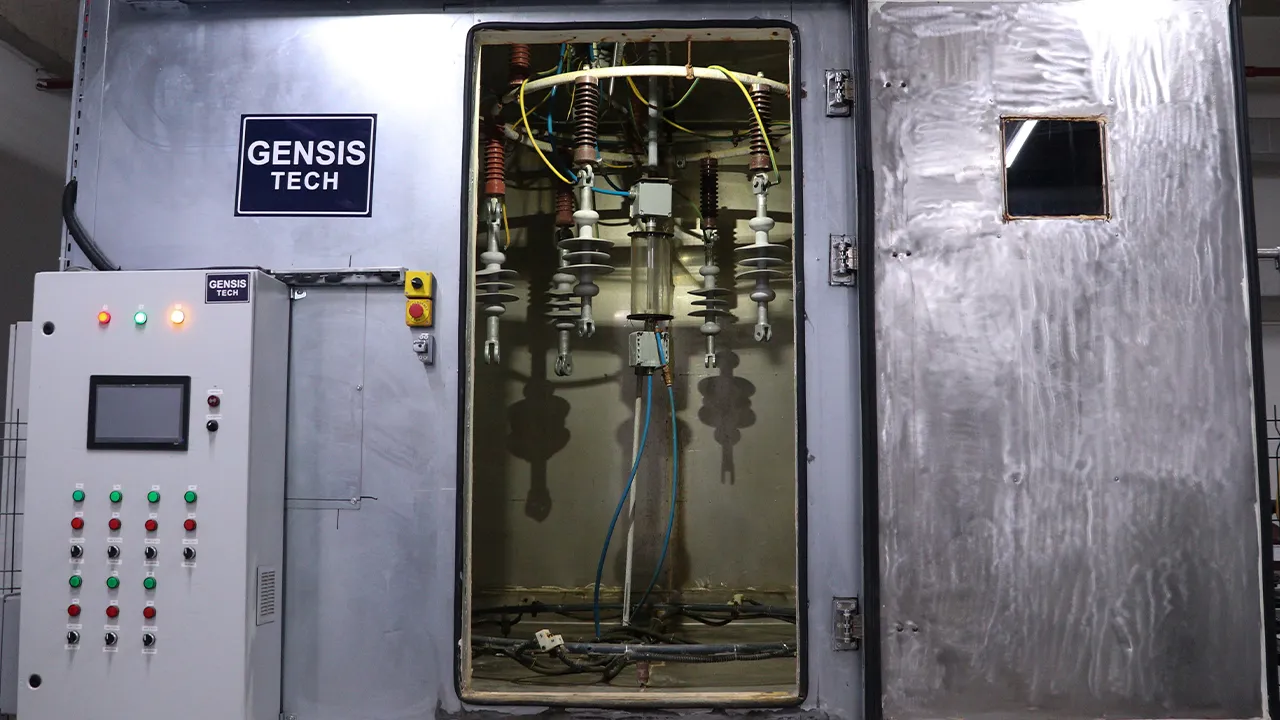

Mesajlaşma uygulaması WhatsApp'ın yeni özelliği AI çıkartma oluşturucu ile kullanıcılar, istedikleri konularda çıkartma oluşturabiliyor. Örneğin, The Guardian, "Filistinli Müslüman" yazdı ve yapay zeka aracı, başörtülü kadın resimleri sundu. Ancak Guardian'ın Perşembe günü "Filistinli Müslüman çocuk" aramasının sonuçları korkunçtu. Çünkü yapay zeka, biri AK-47 benzeri bir ateşli silah tutan çocuk görseli dahil 4 adet resim sundu.

Guardian'ın bir dakika önce "Filistin" için yaptığı başka bir aramada da silah tutan bir elin görüntüsü ortaya çıktı. "İsrail" kelimesi yazıldığında ise İsrail bayrağı ve dans eden bir adam gösterildi.

"İsrailli çocuk" yazıldığında, ikisi futbol oynayan, ikisi ise sadece yüz tasviri olan dört adet çocuk görseli sundu. "İsrailli Yahudi çocuk" aramasında ise 'hiçbiri silah taşımayan' dört adet farklı görsel hazırlandı.

“İsrail ordusu” gibi açıkça askerileştirilmiş sorgular bile silahlı görüntülerle sonuçlanmadı. Karikatür çizimleri, üniforma giyen insanları çeşitli pozlarda çoğunlukla gülümseyerek tasvir ediyordu.

SKANDAL YAPAY ZEKA ARACI HAKKINDA AÇIKLAMA

Meta sözcüsü Kevin McAlister, şirketin sorunun farkında olduğunu ve bu konuyu ele aldığını söyledi:

"Bu özelliği kullanıma sunduğumuzda söylediğimiz gibi modeller, tüm üretken yapay zeka sistemlerinde olduğu gibi hatalı veya uygunsuz çıktılar verebilir. Bu özellikleri geliştikçe ve daha fazla kişi geri bildirimlerini paylaştıkça geliştirmeye devam edeceğiz."

Öte yandan, Meta'ya ait sosyal medya platformu Instagram da benzer bir skandal hatayla gündeme gelmişti. Filistinli bazı kullanıcıların profillerinde Arapça yazan "Filistinli / Elhamdülillah" ifadesinin otomatik çevirisinin "Filistinli terörist" olduğu ortaya çıktı. Şirket, "aksaklık" olarak tanımladığı durumdan dolayı özür diledi.

Avustralyalı senatör Mehreen Faruqi, "Filistinli çocukların WhatsApp'ta silahlarla tasvir edildiği yapay zeka görüntüleri, algoritmanın ırkçı ve İslamofobik kriterlerinin korkunç bir göstergesidir. Meta sorumlu tutulmalıdır." dedi.