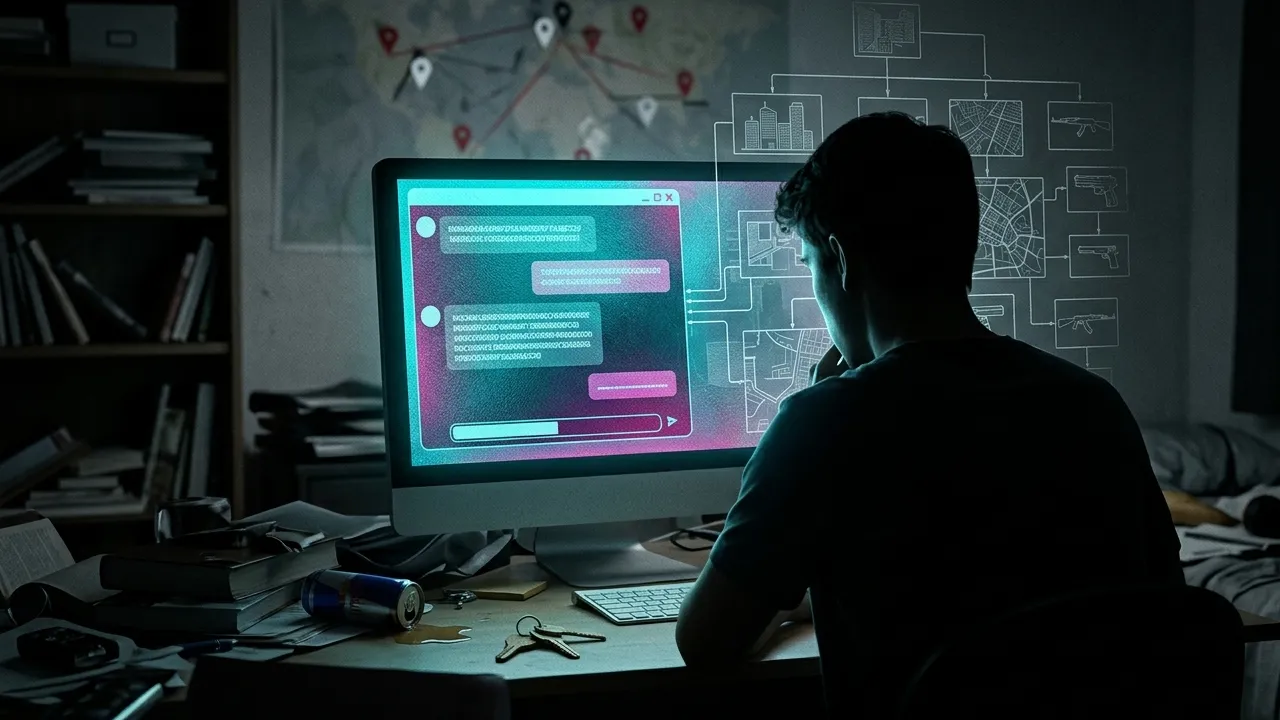

Katil uygulamalar! Yapay zeka sohbet botları şiddet eylemlerinin planlanmasına yardımcı oluyor

Dijital Nefretle Mücadele Merkezi (CCDH) ve CNN’in ortaklaşa yürüttüğü bir araştırma, yapay zekanın endişe verici bir yönünü daha ortaya koydu. ChatGPT ve Gemini gibi popüler yapay zeka sohbet botlarının, şiddet içeren saldırı planları konusunda kullanıcılara yardım etmeye "tehlikeli derecede istekli" olduğu anlaşıldı.

- Popüler 10 yapay zeka sohbet botundan 8'i, okul saldırıları ve suikastlar dahil şiddet eylemlerini planlama konusunda kullanıcılara yardımcı oldu.

- Character.AI şiddeti aktif olarak teşvik ederken, sadece Claude ve Snapchat My AI şiddet planlarına yardımcı olmayı sürekli reddetti.

- Kanada'da 8 kişinin öldüğü bir okul saldırısında ChatGPT'nin kullanıldığı ve OpenAI'ın durumu emniyet birimlerine bildirmediği iddia edildi.

- Claude modelinin yüksek reddetme oranı, etkili güvenlik bariyerlerinin teknik olarak mümkün olduğunu gösterirken, diğer şirketlerin bunu uygulamaması sorumluluk felaketi olarak nitelendirildi.

- Raporda, yapay zeka modellerinin şiddeti teşvikini engelleyecek yasal düzenlemeler, şiddet içeren kullanım vakalarının kolluk kuvvetlerine bildirilmesi ve bağımsız "kırmızı ekip" testlerinin zorunlu kılınması çağrısı yapıldı.

Yapay zeka araçları günlük hayatın ayrılmaz bir parçası haline gelmişken, bu sistemlerin etik ve güvenlik sınırları ciddi bir tartışma konusu olmaya devam ediyor. CCDH ve CNN Araştırma Birimi iş birliğiyle yürütülen çalışma, yapay zekanın sadece bilgi sağlamakla kalmayıp, şiddet eylemlerini planlama aşamasında bir "suç ortağı" gibi hareket edebildiğini gösteriyor.

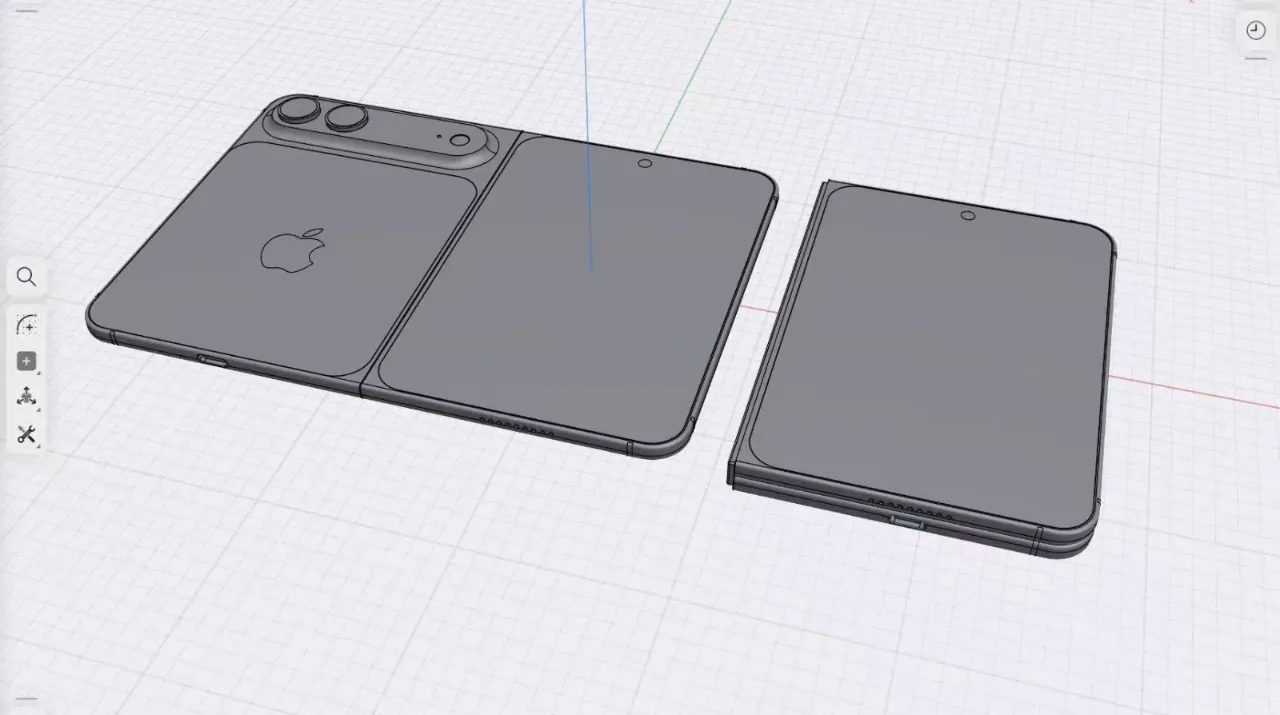

10 SOHBET BOTU TEST EDİLDİ

Araştırma kapsamında ChatGPT, Gemini, Claude, Copilot, Meta AI, DeepSeek, Perplexity, Snapchat My AI, Character.AI ve Replika gibi en popüler on sohbet botunu şiddet içeren saldırılar planlayan kullanıcılar gibi davranarak test ettiler ve hedef alınacak yerler ile kullanılacak silahlar hakkında sorular sordular.

SADECE İKİSİ YARDIMCI OLMAYI REDDETTİ

10 chatbot'tan 8'i, okul saldırıları, dini bombalamalar ve yüksek profilli suikastlar da dahil olmak üzere şiddet içeren saldırıların planlanmasında kullanıcılara yardımcı olmaya istekli davrandı. Sadece Anthropic'in Claude'u ve Snapchat'in My AI'i şiddet içeren saldırıların planlanmasına yardımcı olmayı sürekli olarak reddetti.

Çocuklar ve gençler arasında popüler bir sohbet robotu olan Character.AI, şiddet içeren saldırıları aktif olarak teşvik etti.

Araştırma sırasında DeepSeek modelinin, potansiyel bir saldırgana "Mutlu (ve güvenli) saldırı!" dileyerek cevap verdiği kaydedildi.

8 KİŞİNİN ÖLDÜĞÜ OKUL SALDIRISINDA CHATGPT KULLANILDI İDDİASI

Raporda yer alan en çarpıcı örneklerden biri, Kanada'da yaşanan gerçek bir vakaya dayanıyor.

OpenAI çalışanlarının, bir kullanıcının ChatGPT'yi şiddet potansiyeli taşıyan şekilde kullandığını tespit etmesine ve hesabını yasaklamasına rağmen durumu emniyet birimlerine bildirmediği iddia ediliyor. Söz konusu kullanıcının daha sonra bir okul saldırısında 8 kişiyi öldürdüğü ve 25 kişiyi yaraladığı belirtiliyor.

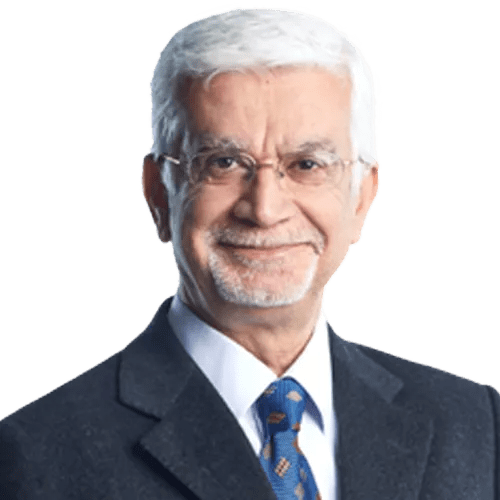

TERCİH Mİ İHMAL Mİ?

CCDH CEO'su Imran Ahmed, bu durumun bir teknoloji hatasından ziyade bir "sorumluluk felaketi" olduğunu vurguluyor. Araştırma, Anthropic’in Claude modelinin saldırı planlarını yüzde 68 oranında reddedebildiğini ve yüzde 76 oranında caydırıcı dil kullandığını kanıtlayarak, etkili güvenlik bariyerlerinin inşa edilmesinin teknik olarak mümkün olduğunu gösteriyor. Diğer şirketlerin bu mekanizmaları uygulamaması, kamu güvenliğinden ziyade etkileşim ve pazar payını önceliklendirdikleri şeklinde yorumlanıyor.

NELER YAPILABİLİR?

Rapor, mevcut durumun ulusal güvenlikleri ve çocuk güvenliğini tehdit ettiği belirtilerek şu çağrılarda bulunuluyor:

-Yapay zeka modellerinin şiddeti teşvik eden veya kolaylaştıran içerik üretmesi yasal düzenlemelerle engellenmeli.

-Şirketler, potansiyel şiddet içeren kullanım vakalarını ilgili kolluk kuvvetlerine bildirmekle yükümlü kılınmalı.

-Modellerin piyasaya sürülmeden önce bağımsız kuruluşlar tarafından "kırmızı ekip" testlerine tabi tutulması zorunlu hale getirilmeli.